La importancia de detectar cuanto antes las altas capacidades: el método asturiano

Durante el siglo XX se han desarrollado diferentes investigaciones sobre inteligencia, partiendo cada una de ellas desde diferentes marcos teóricos. Desde las teorías monolíticas que definen la inteligencia como única variable a las que definen inteligencia como una estructuración tridimensional (estímulo-organismo-respuesta), pasando por la teoría factorial (con los componentes de comprensión verbal, fluidez verbal, razonamiento abstracto, numérico o espacial) o los planteamientos jerárquicos.

Los primeros estudios específicos sobre altas capacidades nacen de forma paralela al estudio de la inteligencia. Para entender las altas capacidades intelectuales hay que comprender que son multidimensionales y que su detección y evaluación no consisten en el etiquetado en un momento determinado, sino que precisan un seguimiento continuo.

Ambas, la detección y el seguimiento, han de realizarse desde la escuela inclusiva y por medio de una enseñanza personalizada..

Habilidades y talentos

Ya en 1985, se planteó que la superdotación está asociada la mayoría de las veces con la habilidad intelectual general (g) mientras que el talento denota destrezas o aptitudes más específicas que evolucionan a lo largo del tiempo mediatizados por la familia, el colegio, la personalidad, los intereses, las actitudes.

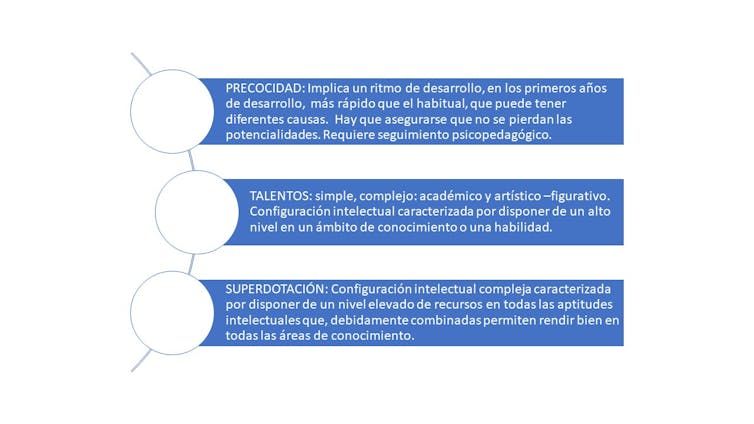

A día de hoy, la mayoría de autores que examinan las altas capacidades diferencian varios aspectos dignos de destacar: precocidad (ritmo de desarrollo más rápido de lo habitual), talentos (alto nivel en uno o varios ámbitos de conocimiento) y superdotación (nivel elevado de recursos en todas las áreas del conocimiento)

Vulnerabilidad y debilidades

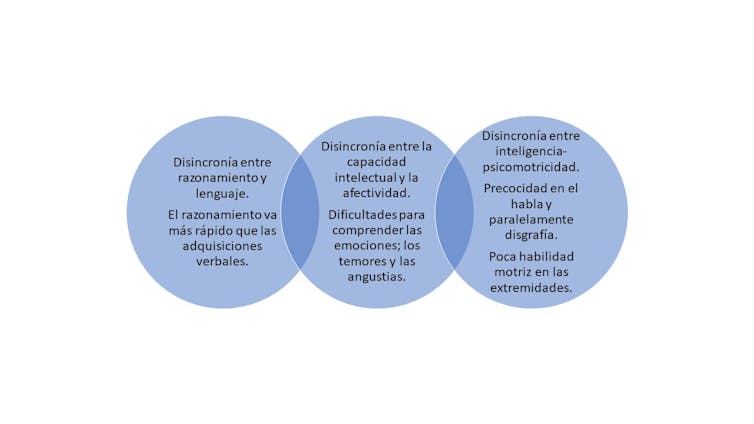

Cabe pensar inicialmente que los superdotados y las personas con altas capacidades brillan en todos los campos. Sin embargo, estar incluidos en estos parámetros psicométricos no garantiza destacar en todas las áreas académicas ni conseguir un expediente brillante. Las altas capacidades pueden presentar una disincronía entre la parte intelectual y otras parcelas del desarrollo (académica, social, emocional o personal).

Los niños y niñas con altas capacidades presentan a veces un doble diagnóstico o doble excepcionalidad. Más allá de sus potencialidades, pueden mostrar también debilidades o necesidades educativas. Hablamos de dificultades específicas de aprendizaje (DEA), trastorno del espectro autista (TEA) o trastorno por déficit de atención e hiperactividad (TDAH).. Todo ello ha de ser tratado de forma coordinada por pediatras, psicólogos y pedagogos.

La atención a la diversidad como prioridad

No es de extrañar que los alumnos y alumnas con altas capacidades se sitúen dentro del perfil de alumnado con necesidades específicas de apoyo educativo (NEAE). Y por tanto será preciso realizar una evaluación psicopedagógica individualizada con el fin de concretar la potencialidad de la alumna o alumno y establecer una respuesta educativa ajustada a sus necesidades específicas. La identificación de las altas capacidades se centrará en la discrepancia existente entre el nivel de aptitud y su rendimiento. Ahí radica una de las claves.

A este respecto, conviene recordar que las leyes de educación contemplan las altas capacidades desde hace años y la LOMLOE promueve la atención a la diversidad establecida en la LOE. A su vez, determina que la escolarización del alumnado con necesidad específica de apoyo educativo deberá estar regida por principios tales como: inclusión y participación, calidad, no discriminación e igualdad efectiva en el acceso y permanencia en el sistema educativo, con accesibilidad universal para todo el alumnado. En otras palabras, lo que pretende la ley es reforzar las posibles medidas de intervención en el ámbito escolar.

¿Por qué razón lo hace? Si la legislación contempla esta realidad y la regula es porque es consciente del problema: existe en las aulas un perfil de alumnado que necesita determinados ajustes en la respuesta educativa, pero, si el sistema educativo no los detecta, entonces ¿cómo podemos ofrecerles la atención y tratamiento que requieren?

La detección temprana

Las altas capacidades se manifiestan frecuentemente en la primera infancia. Algunos autores advierten que el periodo idóneo para su detección es de los 4 a los 7 años. Los casos no siempre son evidentes y suele haber camuflajes, entre otras razones por la necesidad que sienten los niños de pertenecer a un grupo y de mimetizarse con su funcionamiento, intereses y competencias.

Desde que Martina Horner en 1972 describiera el llamado “miedo al éxito” de las chicas, han proliferado muchas investigaciones, también dentro de las altas capacidades. Estas alumnas, ante el temor del posible rechazo social, pueden bajar su rendimiento académico con el objetivo de ser aceptadas.

En la década de los años 70, el experto estadounidense Joseph Renzulli propuso el modelo de detección de los tres anillos: una capacidad intelectual superior a la media, un alto grado de motivación y de compromiso con la tarea y, por último, altos niveles de creatividad.

Rasgos definitorios

Este modelo, a pesar del tiempo que ha pasado, sigue vigente. El reto para el profesorado consistirá en advertir los rasgos definitorios. ¿Cómo hacerlo? Los alumnos con altas capacidades se podrán identificar tanto por sus capacidades intelectuales como por su forma de gestionarlas. Sin ignorar su heterogeneidad y teniendo presente que se manifiestan de modo personal y con diverso grado de intensidad.

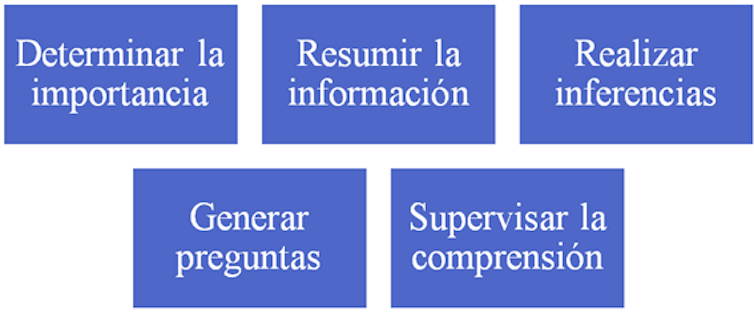

¿Qué rasgos son más significativos? Quienes poseen altas capacidades se caracterizan por mostrar independencia de pensamiento y generar ideas múltiples. Además, utilizan procesos de pensamiento flexible. Su creatividad se demuestra a la hora de buscar de manera singular y estratégica las tareas de afrontamiento así como resolver de forma singular los desafíos. Aunque podría decirse que la creatividad no es un rasgo simple que pueda observarse superficialmente. Es multidimensional.

Esto puede verse reflejado en la habilidad que demuestran para pensar a partir del método holístico (del todo a las partes), y también por la gran capacidad de información que manejan y en cómo la gestionan buscando soluciones con gran iniciativa. Así mismo plantean independencia de pensamiento con posiciones fuera de lo habitual.

Por otra parte, si apelamos a la teoría de las inteligencias múltiples planteada por el psicólogo estadounidense Howard Gardner, advertimos que las capacidades de estos niños y niñas no son estáticas, sino más bien un potencial que puede desarrollarse con el tiempo.

Cultivar talentos, no perderlos

Restringir la detección a un enfoque basado únicamente en la evaluación del cociente intelectual (CI) y con criterio de 130 no es, por lo tanto, idóneo. La evaluación psicopedagógica debería recoger al menos cuatro variables: creatividad, capacidad, persistencia en la tarea, intereses y habilidades.

Detectar de manera precoz a los alumnos que poseen estas altas capacidades es importante porque los talentos que no se cultivan se pierden. La escuela del siglo XXI no puede limitarse a impartir contenidos, sino también ha de posibilitar a su alumnado desarrollar las capacidades y talentos tanto dentro como fuera del aula.

El nuevo método asturiano

Podemos resaltar el caso de Asturias, en España, donde recientemente se ha implantado un sistema de detección a través de la Unidad de altas capacidades (UA) dentro del Equipo Regional de ACNEAE (Alumnado con Necesidades Específicas de Apoyo Educativo) de la Consejería de Educación y Cultura. El objetivo estratégico ha sido en primer lugar formar a los docentes para que ayuden en la labor de detección.

El sistema implantado ha sido diseñado en tres fases: en la primera, los tutores identifican indicios; en la segunda, se realiza un seguimiento para que finalmente, con la colaboración de los departamentos de orientación, poder constatar las altas capacidades.

Metodología multinivel

Este novedoso sistema pretende desarrollar una enseñanza personalizada mediante una metodología multinivel dentro de las aulas. Los docentes deberán adecuar su enseñanza a los diferentes ritmos de aprendizaje.

Para evitar que los niños y niñas con altas capacidades pasen inadvertidos y puedan recibir una respuesta educativa adecuada a sus necesidades específicas, será preciso llevar a cabo en el contexto escolar procesos específicos de detección con una atención compartida entre el profesorado y las familias. Y en ese proceso, la colaboración y transparencia resultan claves. Realmente es mucho lo que hay en juego.

Este artículo fue publicado originalmente en The Conversation. Lea el original.

Imagen de

Imagen de