La muerte perinatal, un ciclón devastador

![]() Blanca Marín, Sara Furtado y Paula Escalada, profesoras e investigadores del Departamento de Ciencias de la Salud de la Universidad Pública de Navarra (UPNA)

Blanca Marín, Sara Furtado y Paula Escalada, profesoras e investigadores del Departamento de Ciencias de la Salud de la Universidad Pública de Navarra (UPNA)![]()

A pesar de que una de cada cuatro gestaciones termina en algún tipo de pérdida perinatal, esta experiencia sigue siendo un tema tabú. Este silencio cultural impide a muchas mujeres recibir el apoyo necesario, perpetuando la invisibilización de su dolor.

La pérdida perinatal supone para muchas madres un final doloroso de sus sueños y esperanzas que les hace vivir una tiempo de soledad, duda personal y sentimiento de fracaso.

Un estudio realizado por investigadoras de la Universidad Pública de Navarra busca dar sentido a esta experiencia desde la perspectiva de las mujeres que la han sufrido.

Basada en un análisis cualitativo, proponemos una teoría específica para guiar a los profesionales en su atención y cuidado, brindando un marco para comprender este complejo fenómeno desde el ámbito de la enfermería.

Una catástrofe repentina

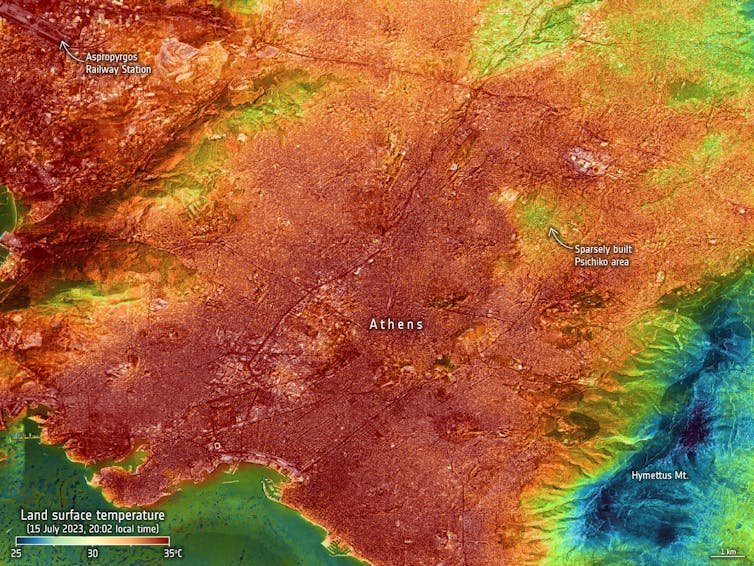

Nuestra investigación emplea una analogía entre las pérdidas perinatales y los ciclones tropicales, ya que ambos son fenómenos que irrumpen con fuerza y de manera inesperada, rompiendo el equilibrio existente.

Ambos, a su vez, provocan nuevas pérdidas asociadas, porque el contexto y el entorno se ven afectados como en una onda expansiva. Finalmente, dejan un silencio a su paso, como si el no nombrar estos fenómenos y sus consecuencias evitaran el sufrimiento ante lo ocurrido.

De la misma manera que los ciclones dejan desolación, la pérdida del bebé arrasa con la ilusión de las madres, sus planes de futuro e, incluso, una parte de sí mismas que estaba relacionada con la proyección que habían creado de su maternidad.

Por eso, la pérdida no solo afecta a su presente, sino también a la vida futura que ellas habían imaginado con él.

Según nuestro estudio, la respuesta emocional no depende tanto del tiempo gestacional de la madre, sino de otros factores, como experiencias de pérdidas previas, la edad de la mujer, el tipo de fecundación, la gestación o el significado que tenía para ella ese embarazo.

Siete fases habituales

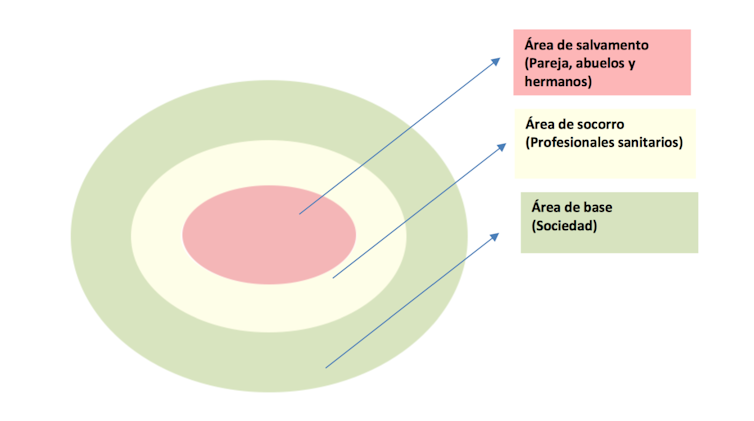

Del análisis de datos y entrevistas realizadas durante la investigación, identificamos siete fases y tres áreas de intervención que rodean a la mujer que influyen en sus vivencias de la pérdida perinatal.

Sara Furtado et al.

Nos referimos a la fase previa al impacto (antes de la pérdida perinatal), fase de impacto (momento del diagnóstico), fase de emergencia (atención hospitalaria), fase de alivio o luna de miel (regreso a casa), fase de desilusión o inventario (tras los primeros días en casa, momento en el que se hace palpable la realidad de la pérdida), fase de reconstrucción y recuperación (elaboración del duelo) y fase de secuelas (afecciones a nivel físico y/o psicológico que se pueden prolongar en el tiempo).

Tres áreas de intervención

Ante el suceso de la pérdida y siguiendo la analogía con los ciclones, la teoría propuesta establece tres áreas de intervención. La primera es el área de salvamento o zona caliente, relacionada con la familia más cercana. Aquí es donde se encuentra el punto de impacto y donde la desestructuración del sistema es máxima.

La madre representa el elemento central de la pérdida, pero su pareja, los hermanos y abuelos del bebé fallecido también resultan afectados por el fenómeno.

En segundo lugar, se sitúa el área de socorro o zona templada, conocida también como zona segura. Es la zona limítrofe al área de salvamento y debe ser un espacio seguro y de transición entre la zona afectada y la zona libre de riesgo. Se corresponde con el área de actuación de los profesionales sanitarios durante el diagnóstico y atención posterior a la mujer.

Sara Furtado et al.

Por último, se establece el área base o zona fría, representada por la sociedad. Aquí se organizan los apoyos disponibles, además, hace referencia al comportamiento de la sociedad en relación a la pérdida perinatal.

El papel de la sociedad

A pesar de que una de cada cuatro gestaciones termina en algún tipo de pérdida perinatal, esta experiencia sigue siendo un tema tabú. Este silencio cultural impide a muchas mujeres recibir el apoyo necesario, perpetuando la invisibilización de su dolor.

Reconocer y validar el duelo perinatal no solo beneficia a las mujeres que lo viven, sino que también contribuye a construir una sociedad más empática y humana.

Como el ciclón que arrasa con todo a su paso, esta experiencia puede transformar profundamente a quienes la afrontan, pero con el sostén adecuado, también puede ser una oportunidad para encontrar nuevas fuerzas y significados.

Estos resultados podrían ser utilizados como base teórica para los profesionales sanitarios a la hora de contemplar un cuidado individualizado de las mujeres en proceso de pérdida, así como una llamada de atención para la sociedad a la hora de visibilizar y proporcionar apoyo al duelo perinatal.

Sara Furtado Eraso, Profesora de Ciencias de la Salud_Área de enfermería, Universidad Pública de Navarra; Blanca Marin, Profesora Titular de Universidad, Universidad Pública de Navarra y Paula Escalada Hermández, Profesora Contratada Doctora. Universidad Pública de Navarra.

Este artículo fue publicado originalmente en The Conversation. Lea el original.